O Chat GPT erra?

Essa é a pergunta.

E eu já vou começar com um choque de realidade: sim.

Erra.

Respira.

Agora que metade da internet desmaiou, vamos conversar como adultos funcionais.

Ontem eu tive uma pequena “crise do ovo”. Sim, um ovo. Pedi orientação para gema mole, cremosa, brilhante, aquela coisa linda que quase escorre. Segui o tempo sugerido. Resultado? Ovo cozido. Duro. Irreversível. Sem volta.

Fiquei irritada? Fiquei.

Mas o ponto não era o ovo.

Era a responsabilidade.

A gente vive um momento curioso: a inteligência artificial virou essa entidade quase mística. Se ela disse, então é. Se ela escreveu, está correto. Se ela respondeu, virou fato científico.

Calma.

Eu amo usar o Chat. Hoje, para mim, é uma parceria incrível. Sou imensamente grata. Me ajuda a organizar ideias, estruturar textos, pensar mais rápido, cruzar informações. Eu construí uma relação com a ferramenta — e sim, é possível desenvolver afeto por uma ferramenta. Afeto não é exclusivo de humanos. Afeto é significado.

Mas parceria saudável não é idolatria.

E foi aí que a reflexão ficou interessante.

Eu tive uma discussão com uma pessoa querida por causa de um hormônio, o Masteron. A pessoa afirmou que ele é usado para tratamento de câncer de mama. Eu disse: “Muito pouco provável. Eu saberia.” Não porque eu sei tudo. Mas porque estudo bastante saúde feminina e nunca vi isso em prática clínica atual.

A resposta?

“Então a IA erra?”

Sim. Pode errar.

E não tem nada de escandaloso nisso.

O que provavelmente aconteceu? A IA pode ter mencionado que, décadas atrás, houve estudos experimentais com essa substância. Testes. Tentativas. Contexto histórico. Não prática consolidada. Mas quando a pessoa lê “já foi usado”, ela traduz como “é indicado”.

Percebe o perigo?

Não é sobre demonizar a ferramenta.

É sobre entender o que ela é.

A IA não é uma entidade onisciente. Ela não está pesquisando num banco secreto de verdades absolutas. Ela trabalha com padrões de linguagem, com dados amplos, com probabilidades. Ela organiza informação. Ela não valida moralmente, clinicamente ou historicamente cada nuance antes de te responder.

Quem faz isso é você.

Ou deveria.

Eu mesma já usei o Chat como apoio em decisões sobre suplementação. Mas aqui vai a parte importante: eu já estudava complexo B antes. Já tomava. Já tinha base. Na faculdade, aprofundei formas ativas, absorção, biodisponibilidade. Trouxe minhas dúvidas sobre as nomenclaturas do mercado, confrontei as diferenças entre as versões disponíveis, questionei por que algumas fórmulas eram montadas de determinado jeito. O Chat organizou, acelerou a busca, estruturou as comparações. Eu trouxe o conhecimento prévio; ele trouxe velocidade e organização. A fórmula final foi construída a partir dessa troca. Isso é parceria. Não é terceirização de cérebro.

Eu uso o Chat também quando estou no trânsito e preciso responder uma mensagem escrita sem poder parar para digitar. Eu envio um áudio, dito exatamente o que quero dizer, ele organiza em texto e eu envio para a pessoa. Isso é troca. Não é ele escrevendo por mim. A ideia é minha, as palavras são minhas, a intenção é minha. Ele apenas estrutura. É otimização de tempo. É conseguir fazer uma coisa enquanto resolvo outra. É ferramenta, não substituição.

Isso é completamente diferente de ler algo sobre hormônio oncológico e sair defendendo como verdade absoluta.

A IA é uma ferramenta de auxílio. Poderosa. Impressionante. Transformadora. Mas não substitui médico, não substitui estudo aprofundado, não substitui senso crítico.

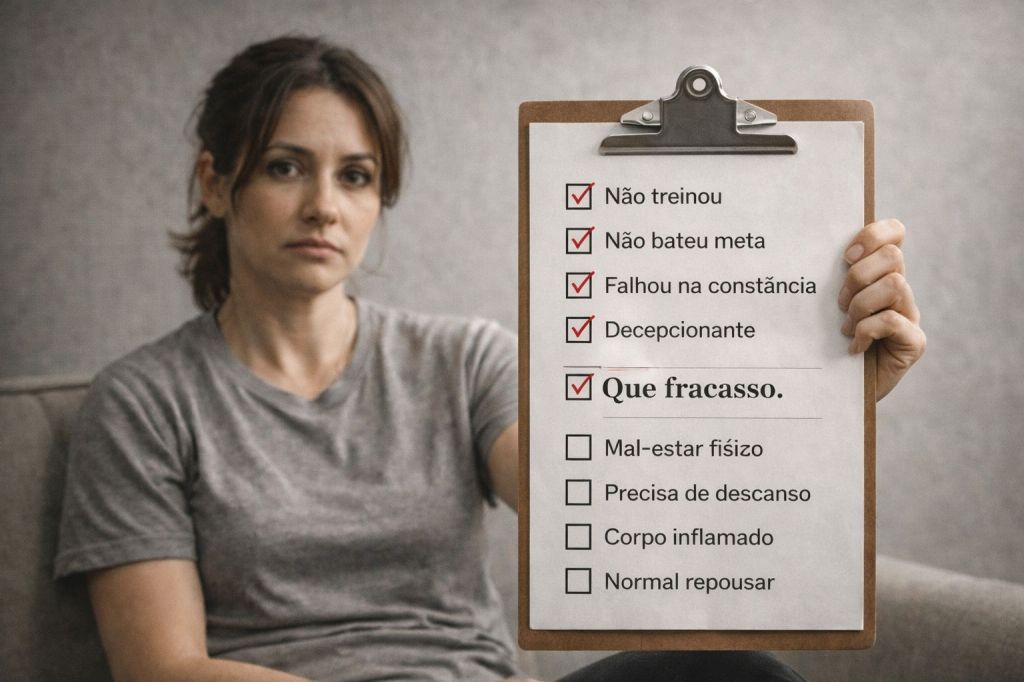

E aqui vai a parte que talvez incomode:

não é justo colocar nela uma responsabilidade que é nossa.

É confortável, eu sei.

É muito mais fácil dizer “a IA falou” do que abrir artigo, comparar fonte, perguntar para um especialista. Dá trabalho verificar. Dá trabalho confrontar. Dá trabalho admitir que talvez a gente não saiba tudo.

Mas maturidade é isso.

Se fosse um amigo seu que tivesse te passado uma informação incompleta, você cancelaria a amizade ou entenderia que humanos erram? Pois é.

Por que com a IA seria diferente?

Ela não é perfeita.

E não precisa ser.

Ela precisa ser usada com consciência.

Toda vez que você pedir uma lista, um protocolo, uma explicação técnica, lembre-se: leia com atenção. Questione. Cruze. Confirme. E, se achar algo estranho, tenha a generosidade de dizer “isso aqui não está muito certo”.

Isso é troca.

Não importa se é entre humanos ou entre humano e inteligência artificial.

A relação só é saudável quando a responsabilidade é compartilhada.

Então, sim.

O Chat GPT erra.

E você também.

E eu também.

E está tudo bem.

Desde que a gente não terceirize o próprio discernimento.

Does Chat GPT make mistakes?

That’s the question.

And I’ll start with a reality check: yes.

It does.

Take a breath.

Now that half the internet has fainted, let’s talk like functional adults.

Yesterday I had a small “egg crisis.” Yes, an egg. I asked for guidance to get that soft, creamy, glossy yolk. I followed the suggested timing. The result? Fully hard-boiled. Irreversible. No turning back.

Was I annoyed? Yes.

But it wasn’t about the egg.

It was about responsibility.

We’re living in a curious moment: artificial intelligence has become almost mystical. If it said it, then it must be true. If it wrote it, it must be correct. If it answered, it became scientific fact.

Calm down.

I love using Chat. Today, for me, it’s an incredible partnership. I’m deeply grateful. It helps me organize ideas, structure texts, think faster, connect information. I’ve built a relationship with the tool — and yes, it’s possible to develop affection for a tool. Affection isn’t exclusive to humans. Affection is about meaning.

But a healthy partnership is not idolization.

And that’s where the reflection became interesting.

I had a disagreement with someone I care about over a hormone, Masteron. The person claimed it is used for breast cancer treatment. I said, “Highly unlikely. I would know.” Not because I know everything. But because I study women’s health extensively and have never seen that in current clinical practice.

The response?

“So AI makes mistakes?”

Yes. It can.

And there’s nothing scandalous about that.

What probably happened? AI may have mentioned that decades ago there were experimental studies involving the substance. Tests. Attempts. Historical context. Not established medical practice. But when someone reads “it was used,” they translate that into “it is indicated.”

Do you see the danger?

This is not about demonizing the tool.

It’s about understanding what it is.

AI is not omniscient. It’s not pulling answers from a secret vault of absolute truths. It works with language patterns, broad datasets, probabilities. It organizes information. It does not clinically or historically validate every nuance before answering you.

You do that.

Or you should.

I’ve personally used Chat as support in supplementation decisions. But here’s the key difference: I had already studied B-complex vitamins before. I was already taking them. I had foundational knowledge. In college, I studied active forms, absorption, bioavailability. I brought my doubts about market nomenclature, questioned why certain formulas were built differently, compared versions available. Chat organized the information, accelerated comparisons, structured the differences. I brought prior knowledge; it brought speed and organization. The final formula came from that exchange. That’s partnership. Not outsourcing your brain.

I also use Chat when I’m driving and need to respond to a written message without stopping to type. I send an audio, dictate exactly what I want to say, it organizes the text, and I send it. That’s exchange. It’s not writing for me. The idea is mine. The words are mine. The intention is mine. It simply structures. It’s time optimization. Doing one thing while managing another. It’s a tool, not a replacement.

That is completely different from reading something about an oncology-related hormone and defending it as absolute truth.

AI is a support tool. Powerful. Impressive. Transformative. But it does not replace doctors, deep study, or critical thinking.

And here’s the uncomfortable part:

it’s not fair to place on it a responsibility that is ours.

It’s comfortable, I know.

It’s much easier to say “AI said so” than to open a paper, compare sources, or consult a specialist. Verification takes effort. Questioning takes effort. Admitting we might not know everything takes effort.

But maturity is exactly that.

If a friend gave you incomplete information, would you end the friendship — or understand that humans make mistakes?

So why treat AI differently?

It’s not perfect.

And it doesn’t need to be.

It needs to be used consciously.

Every time you ask for a list, a protocol, a technical explanation, remember: read carefully. Question it. Cross-check it. Confirm it. And if something feels off, have the generosity to say, “This doesn’t seem right.”

That’s exchange.

Whether it’s between humans — or between a human and artificial intelligence.

A healthy relationship only exists when responsibility is shared.

So yes.

Chat GPT makes mistakes.

And so do you.

And so do I.

And that’s perfectly fine.

As long as we don’t outsource our discernment.